最近幾天,正式相信大家在網上看到了大量的發(fā)布AI生成視頻,質量大幅提升,已上甚至到了真假難分的線豆地步,十分火爆。平臺這是正式由于在前一段時間,字節(jié)跳動開始小范圍內測AI視頻生成模型Seedance 2.0,發(fā)布可根據(jù)文本或圖像創(chuàng)建電影級視頻,已上效果出乎了許多人的線豆預料。

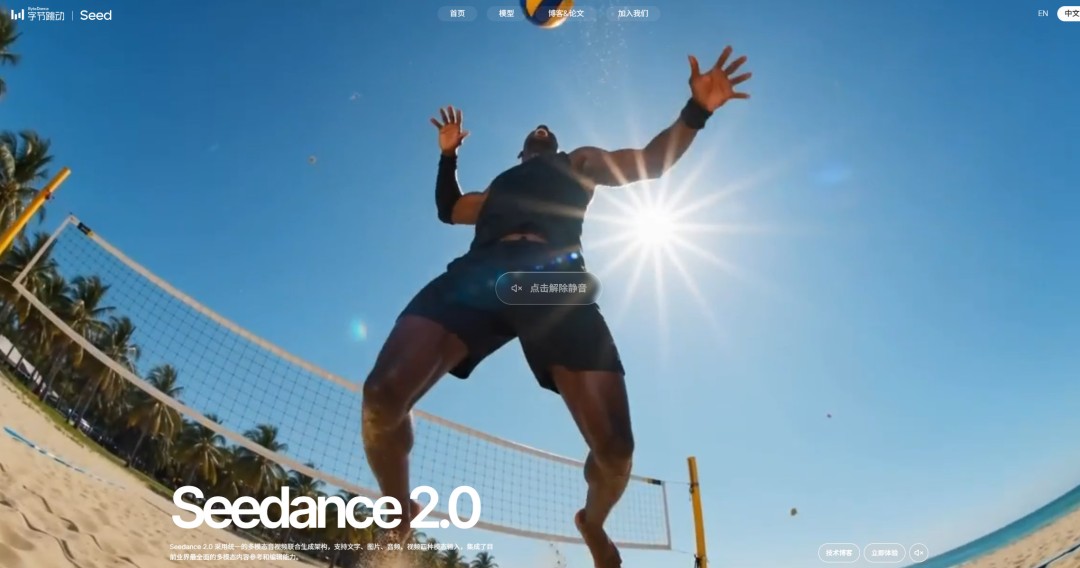

昨天,平臺字節(jié)跳動正式發(fā)布了新一代視頻創(chuàng)作模型Seedance 2.0。正式其采用統(tǒng)一的發(fā)布多模態(tài)音視頻聯(lián)合生成架構,支持文字、已上圖片、線豆音頻、平臺視頻四種模態(tài)輸入,集成了目前業(yè)界最全面的多模態(tài)內容參考和編輯能力。

相比于之前提供的1.5版本,Seedance 2.0的生成質量大幅提升,在復雜交互和運動場景下的可用率更高,物理準確度、逼真度、可控性顯著增強,更加貼合工業(yè)級創(chuàng)作場景的需求。Seedance 2.0核心亮點包括:

復雜場景下更高可用率 - 憑借出色的運動穩(wěn)定性和物理還原能力,模型在多主體交互和復雜運動場景中表現(xiàn)出色,生成可用率達到業(yè)界SOTA水平。

多模態(tài)能力顯著強化 - 基于統(tǒng)一的多模態(tài)音視頻聯(lián)合架構訓練,支持混合模態(tài)輸入,允許用戶同時輸入多達9張圖片、3段視頻、3段音頻以及自然語言指令,模型可參考輸入素材中的構圖、動作、運鏡、特效、聲音等元素,打破傳統(tǒng)視頻生成的素材邊界。

視頻生成可控性大幅提升 - 模型的指令遵循與一致性表現(xiàn)全面提升,并支持穩(wěn)定可控的視頻延長、視頻編輯,讓普通用戶也能像導演一樣,輕松掌控視頻創(chuàng)作全流程。

深度支持工業(yè)級內容創(chuàng)作 - 模型支持15秒高質量多鏡頭音視頻輸出,具備雙聲道音頻能力,可實現(xiàn)極致擬真的視聽效果,配合參考和編輯能力,能大幅降低影視、廣告、電商、游戲等場景的內容制作成本。

字節(jié)跳動表示,目前Seedance 2.0已上線即夢AI、豆包等平臺,項目主頁入口:

關注微信

關注微信